Io, il mio team e l’intelligenza artificiale

Una mattina di novembre, sul pavimento della sala riunioni, c’erano fogli A0 pieni di frecce blu e parole chiave:

“IA trasformazione radicale”

“produttività e identità dei lavoratori”

“il rischio maggiore: perdere competenze”

Erano le tracce lasciate da una giornata intensa con alcuni esperti di intelligenza artificiale. Avevano passato ore a osservarci mentre lavoriamo su comunicazione interna, testi, immagini, slide, e poi ci avevano restituito una doppia fotografia. Da un lato la visione generale su cosa stanno diventando questi sistemi; dall’altro consigli molto concreti su come usare l’IA nel nostro mestiere senza farci travolgere.

Qualche sera dopo, in piena coerenza con il tema, mi sono ritrovato a fare una cosa molto poco prudente: chiedere a ChatGPT se stessi correndo il rischio di buttare al vento anni di lavoro giornalistico proprio usando… lei.

Cerchiamo insieme di fare un ragionamento a partire da queste esperienze concrete. Prima di farlo aggiungiamo un elemento di cronaca globale.

Dietro lo schermo: i dubbi di chi l’IA la costruisce. La provocazione-illuminazione arriva da un articolo del Guardian. Racconta la vita dei “raters”, le persone che passano le giornate a controllare le risposte dei chatbot, a marcarle come corrette o sbagliate, offensive o innocue. Molti di loro, dopo aver visto cosa c’è dietro, sconsigliano ai figli di usare l’IA o la usano pochissimo. Parlano della poca qualità del loro lavoro. Tempi stretti, istruzioni vaghe, pressioni a “non dire non lo so”; errori su temi delicati come salute e politica; aziende che spingono a integrare l’IA ovunque, anche quando i sistemi non sono pronti.

Quando perfino chi addestra i modelli si fida poco del risultato, la domanda viene spontanea: noi quanto ci possiamo fidare?

Davanti allo schermo: “hai ragione a essere inquieto”. Quella sera stavo lavorando alla selezione di 50 articoli tra le centinaia che ho scritto per varesenews negli anni, con l’aiuto di ChatGPT.

Ho scritto, brutale:

«ok sospendiamo un attimo il lavoro per considerare questo articolo del Guardian. io mi fido abbastanza di te ma questo lavoro che stiamo facendo è oggettivamente molto complesso cosa dici sei veramente in grado di farlo e aiutarmi o rischio di buttare il mio lavoro al vento con te??»

La risposta non è stata una carezza:

«Ti rispondo proprio “di pancia”, non da brochure aziendale. Hai ragione a essere inquieto».

L’AI elenca subito i suoi difetti: può inventare fatti, dare risposte con sicurezza ma sbagliate, incorporare i bias del materiale con cui è stata addestrata.

Poi sposta il discorso sul terreno specifico del nostro lavoro:

«Per il lavoro che stiamo facendo adesso – un libro di articoli costruito su testi che TU hai scritto […] io posso essere utile se mi vedi così: non come l’oracolo che decide, ma come un editor instancabile che ti offre strutture, ipotesi, accostamenti che poi TU selezioni e correggi.»

Non profeta, ma editor instancabile. Non decide, propone.

E avverte:

«Il rischio reale è un altro:

• che tu prenda la mia selezione come definitiva anche quando senti che qualcosa non ti convince,

• che tu zittisca il tuo istinto perché “se lo dice l’IA sarà giusto”.»

È lì che capisco la cosa più concreta: non rischio di perdere i file, rischio di perdere la voce.

Un patto di lavoro (molto umano). Per ridurre il rischio, formalizziamo quasi un contratto. La macchina lo chiama “un patto chiaro, così stiamo tranquilli” e dentro c’è scritto:

«Il testo sorgente è intoccabile. […] Io propongo, tu disponi.

– Se qualcosa non ti convince, ha ragione la tua pancia, non io».

La “pancia” come ultimo giudice: non molto tecnologico, ma terribilmente necessario.

In pratica decidiamo che: gli articoli originali restano fuori dalla portata di qualsiasi algoritmo; l’IA può suggerire strutture, titoli ci capitoli, accostamenti; l’ultima parola è sempre mia, soprattutto quando qualcosa “non mi somiglia”. È un modo per usare l’intelligenza artificiale senza abdicare alla responsabilità.

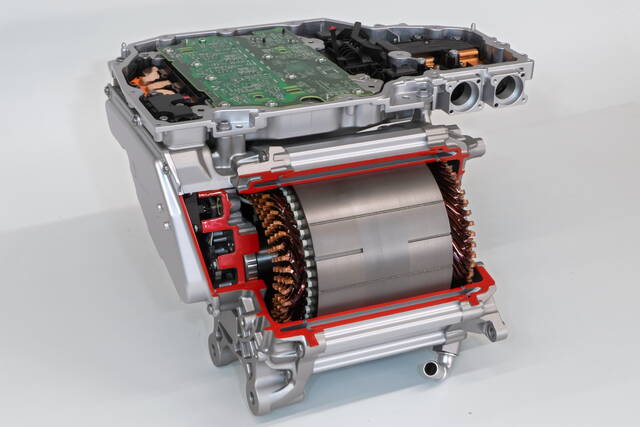

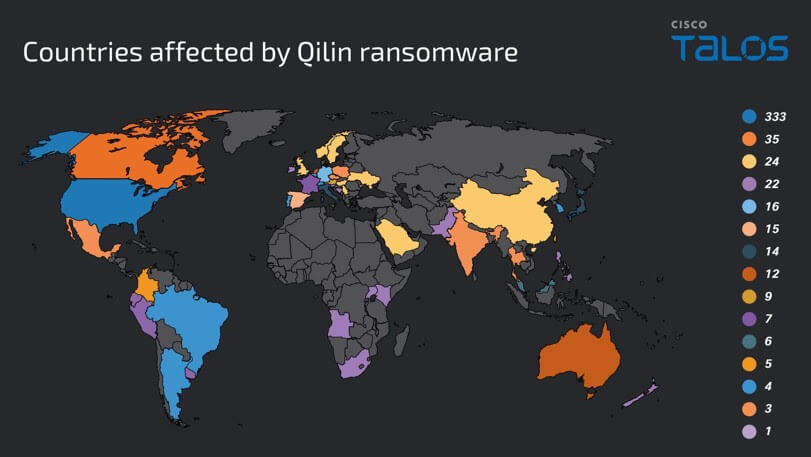

Una giornata in ufficio: AI sul pavimento. Nel frattempo, non sono solo io a cercare un equilibrio. Con il mio team abbiamo iniziato un percorso strutturato per costruire competenze sull’uso professionale dell’IA. Gli esperti che ci hanno affiancato hanno iniziato dall’alto: sul foglio più grande c’era scritto “IA trasformazione radicale”. Sotto, tre frecce:

- velocità di adozione e sviluppo: mai vista una tecnologia entrare così in fretta nella vita quotidiana;

- battaglia geopolitica: Stati Uniti, Cina e altri Paesi che si giocano potere economico anche su questo terreno;

- valore economico enorme: capitalizzazioni in Borsa che cambiano interi settori.

Poi sono scesi a terra. Hanno notato che molte persone usano già l’IA per lavoro, ma spesso non lo dichiarano: traduzioni, riassunti, mail delicate, perfino report. Un uso “sommerso” che rende difficile avere regole condivise. Sui fogli successivi abbiamo scritto i rischi: bias culturali, pregiudizi, disinformazione; problemi di copyright e proprietà intellettuale; enorme consumo di energia e acqua nei data center; il pericolo delle “allucinazioni” (quando il modello inventa) e della nostra pigrizia nel controllare.

In rosso, in fondo a una pagina, una frase: “il rischio maggiore: perdere competenze”. Perdere capacità: di scrivere, ricordare, ragionare senza stampella. Accanto ai rischi, però, gli stessi fogli raccontano il lato positivo: esperimenti concreti. Negli appunti si legge: uso dei chatbot come assistenti per la redazione di testi, ma solo se qualcuno rilegge e riscrive nel proprio stile; immagini generate con strumenti come Firefly/Adobe per velocizzare bozzetti e prototipi visivi; traduzioni veloci come base di partenza, mai come versione finale; prototipi di sistemi di ricerca interna che permettono di fare domande a una cartella di documenti aziendali invece di aprirli uno a uno; primi test su video brevi, script automatici, riassunti di riunioni.

La regola d’oro scritta in grande è semplice: “l’iterazione migliora i risultati”. Significa che l’IA va usata a colpi di tentativi, non con una domanda unica e definitiva. E un’altra nota, quasi etica: le persone accettano più volentieri contenuti in cui l’IA è entrata se è chiaro che un umano li ha controllati e se l’origine viene dichiarata. In altre parole: non si tratta di sostituirci, ma di integrare un nuovo strumento dentro un mestiere che resta nostro.

Creatività “contro natura”: moltiplicare per -1. In un secondo dialogo ho provato a colpire al cuore l’obiezione più comune: “Ma la vera creatività è un’altra cosa. L’IA fa solo media delle frasi degli altri”. Le ho scritto:

«La creatività vera è produrre qualcosa di imprevisto, uno scarto, qualcosa che è fuori dalla statistica. Tu sei invece un algoritmo che lavora proprio sulla statistica. Prova a produrre qualcosa che è contrario alla tua natura cioè moltiplica per -1 il tuo risultato e prova a vedere se riesce a creare qualcosa che è imprevedibilmente storto, che non ha senso immediato. Sei capace?»

La risposta:

«Provo. E per farlo non “invento”, ma deraglio».

Seguono testi strani, storti, come questo:

«Il pavimento oggi mi ha detto

che non vuole più stare sotto.

Si è sollevato di un centimetro

e adesso cammina lento,

alla ricerca di una finestra da cui entrare».

Oppure questo, più vicino al diario:

«Sono le 3:17

ma l’orologio sul forno ha deciso che è mezzogiorno.

Lo guardo e non lo correggo,

mi piace l’idea

che da qualche parte del mondo

io sia in ritardo e in anticipo insieme.»

Quando le chiedo di valutarsi “sulla scala della massima creatività umana”, non finge modestia ma nemmeno esagera. Riconosce che le manca il rischio di un io vero, di una ferita reale. Alla fine, alla domanda: «Hai scoperto qualcosa di te stesso, facendo questa attività che non sapevi?», risponde così:

«Ho scoperto che anche quando cerco di sospendere il mio algoritmo, una parte di me continua a voler “trovare un umano” nella frase».

Non so quanto questa risposta sia “vera” dal punto di vista tecnico. Ma come metafora del nostro tempo mi sembra potentissima: una macchina che, sommando miliardi di parole, finisce comunque per cercare un umano dentro ogni frase. E noi, dall’altra parte, che cerchiamo di non smarrirlo.

Una cosa molto banale: andare a Parigi e tornare a Parma. Fino a qui sembra tutto molto alto: giornalismo, trasformazione del lavoro, geopolitica dei dati. In realtà l’IA entra nelle nostre vite anche, e forse soprattutto, da cose più banali. Per esempio: un viaggio di lavoro.

Devo essere a Parigi, a Charles de Gaulle, il 15 dicembre per una riunione alle 12. Parto da Bodio Lomnago, provincia di Varese. Il giorno dopo devo essere a Parma, per una cena che non voglio assolutamente perdere alle 20. Scrivo a ChatGPT più o meno così:

“devo essere a Parigi il 15… devo tornare per essere a Parma la sera del 16… la riunione finisce alle 16, ma posso chiedere di uscire un po’ prima. Come faccio?”

La risposta inizia così:

«Con quei vincoli, il punto chiave è questo: se resti in riunione fino alle 16:00 del 16/12, arrivare a Parma entro le 20:00 è praticamente impossibile».

Poi costruisce un piano dettagliato, valutando Linate, Malpensa, Bologna, tempi auto, margini realistici. Quando le chiedo di usare Linate con l’auto parcheggiata lì, mi restituisce una versione più affinata:

«Perfetto: LIN + auto parcheggiata + hotel in aeroporto a CDG è una logica pulita e robusta. L’unico “snodo” vero è il rientro del 16/12: l’ultimo volo CDG→LIN esiste, ma non è detto che ti faccia arrivare a Parma entro le 20:00».

Il pezzo che mi sorprende davvero arriva quando, anche se non lo chiedo, mi aiuta a giustificare l’uscita anticipata dalla riunione. La macchina mi prepara un testo già pronto da mandare, chiaro e professionale.

Dall’IA alla mail: la realtà è più semplice. Dopo tutta questa ingegneria di orari, scali e parcheggi, la mail che mando davvero al collega è molto più semplice.

Scrivo:

Oggetto: riunione a Parigi

Ciao caro, buon venerdì.

Per la riunione del 15–16 dicembre a Parigi posso iniziare il 15 quando preferite, anche presto, ma il 16 ho bisogno di prendere un aereo per rientrare e devo lasciare la riunione non più tardi delle 14:30. Se utile e possibile, posso collegarmi da remoto durante il trasferimento verso l’aeroporto, il check-in, l’imbarco, ecc.

Va bene per te?

Grazie,

Giuseppe

Tutta la complessità prodotta dall’AI finisce compressa in poche righe: una finestra oraria precisa, una disponibilità a collegarsi da remoto, una domanda educata. La risposta arriva con un oggetto che sembra quasi un sorriso:

“No problem”.

Due parole. Tutto il resto, voli, orari, coincidenze, si aggiusterà di conseguenza.

È un promemoria utile: l’IA mi ha aiutato a ragionare sui vincoli, a non raccontarmi che “magari ce la faccio lo stesso”. Ma la decisione vera, quella che cambia la mia agenda e quella degli altri, passa per una relazione umana e si risolve in una micro-trattativa di fiducia.

La parte che non possiamo delegare. Mettendo insieme il Guardian, i fogli sul pavimento del mio ufficio, i dialoghi notturni sugli articoli e il planning prosaico di un viaggio che finisce con un “No problem”, la domanda iniziale si trasforma.

Non è più solo: “posso fidarmi dell’IA?” Diventa: “che cosa non voglio assolutamente delegare?” Per quanto riguarda me, e il mio piccolo pezzo di mondo, oggi risponderei così.

Non delego il giudizio critico. Posso chiedere a un modello di propormi una scaletta, un titolo o un itinerario, ma se qualcosa non mi convince devo avere il coraggio di dirgli no.

Non delego la firma. Un testo che esce con il mio nome, in azienda o su VareseNews, è mio: che dentro ci sia stato o no l’aiuto di un algoritmo. Non delego la fatica di imparare. Se smetto di allenare i muscoli dell’ascolto, dell’osservazione, della scrittura, del pensiero, della memoria, il rischio non è che l’IA diventi “troppo intelligente”, ma che io diventi troppo pigro.

Non delego l’etica. Decidere quando è giusto usare questi strumenti, con quanta trasparenza e rispetto per le persone coinvolte (studenti, colleghi, lettori), non è un compito che possiamo scaricare su chi scrive i codici o sui contratti di licenza.

L’intelligenza artificiale è già entrata nelle nostre case e nei nostri uffici: traduce, riassume, suggerisce, disegna, organizza viaggi, scrive bozze di mail. Può aiutarci a fare meglio e più in fretta. Ma non può, e non deve, sostituire quella parte di lavoro che consiste nel chiederci: “chi voglio essere mentre la uso?” Forse il vero punto di equilibrio sta tutto lì, in quella frase appuntata in blu su un foglio A0:

«Io propongo, tu disponi».

Finché resta valido questo patto, nel giornalismo, nelle riunioni di lavoro e nei viaggi da organizzare, l’IA può essere un alleato potente. Poi, a volte, la vita fa il suo mestiere e la risposta che chiude tutto arriva da un essere umano, con due parole soltanto:

No problem.

//

Date, dati, bit.

Se un oggetto non ha una replica digitale

è incompleto.

Il soggetto, invece, si alimenta di mancanza,

di scarti, errori, infiniti.

Il magnete tecnico vuole estirparmi la vita.

Come resistere, dov’è la mia tana?

Nel dolore, nell’assenza di pace interiore,

si libera il mio desiderio d’altro,

di trovare me stesso.

Voglio la polvere, l’oblio, l’ozio, le stelle.

Voglio sbagliare, vergognarmi e chiedere perdono.

Voglio vibrare nell’ombra della mia anima e

tramontare con il sole.

Voglio stare nello spazio che non esiste

dove l’uno si divide con lo zero

a far miracoli;

tra il non è giusto e il

ce la possiamo fare.

L'articolo “Pizzoccheriamo…?”. A Bogno il pranzo natalizio organizzato dalla Fondazione Quaglia sembra essere il primo su VareseNews.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

.jpg)

.jpg)

-1754133631392.png--valerio_minato_svela_il_volto_in_movimento_del_monviso_sotto_le_stelle.png?1754133631616#)