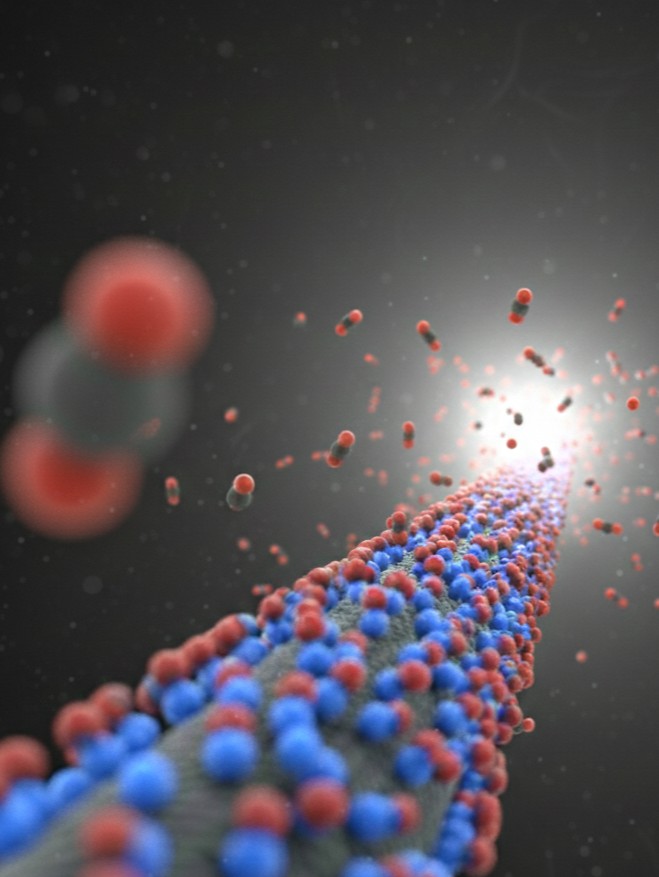

Phishing con AI, ora basta mezz'ora per una truffa estremamente mirata (e pericolosa)

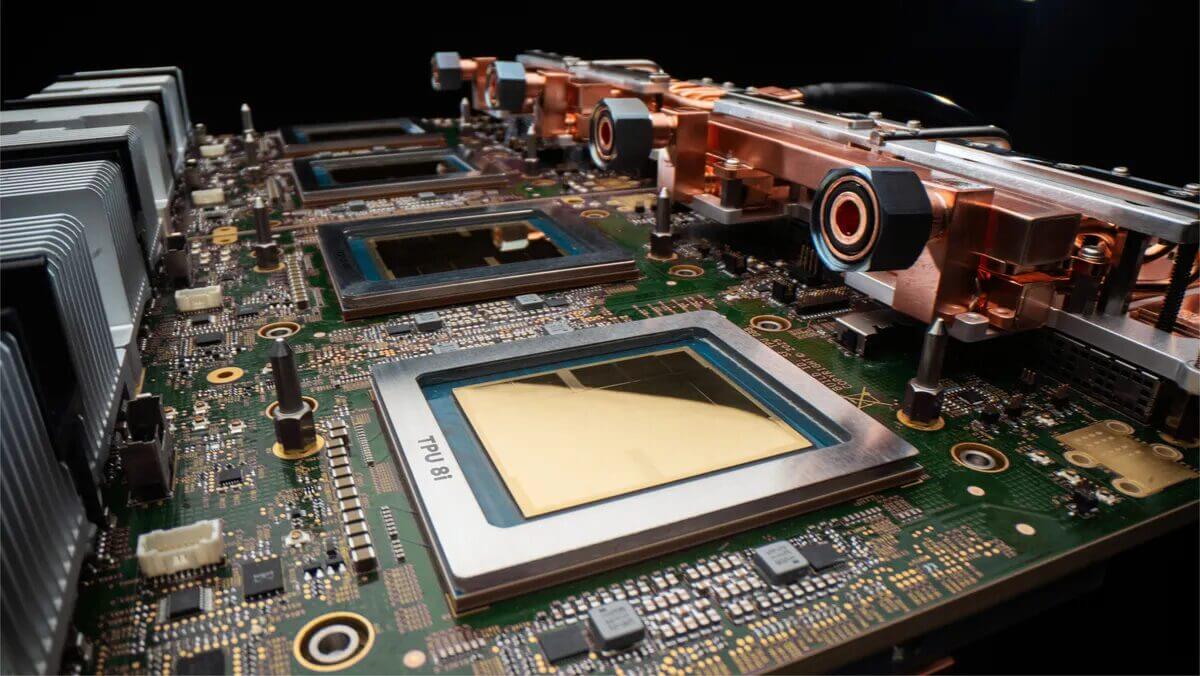

I ricercatori di TrendAI, società di Trend Micro, lanciano l’allarme: usando il materiale pubblicato su LinkedIn si possono ottenere attacchi di phishing estremamente mirati, chirurgici. È uno dei rischi dell’AI, che in pochi passaggi può essere istruita per raccogliere post, immagini e metadati, analizzarli e costruire profili dettagliati delle vittime.

Ci hanno provato loro stessi, con successo. L’aspetto preoccupante è che è tutto perfettamente legale, non c’è violazione della privacy dal momento che a essere raccolte e analizzate sono solamente le informazioni pubblicate volontariamente dall’utente-vittima su un social qual è LinkedIn. Aspetti critici sono l’accessibilità e la velocità con cui si possono istruire un qualsiasi modello AI a compiere operazioni che un tempo erano macchinose ed estremamente lente, al punto, in qualche caso, da scoraggiare i malintenzionati.

L’AI, cercando su LinkedIn, può pure ricostruire l’assetto aziendale, ricostruendo l’altezza della piramide gerarchica in cui è inserita la vittima, con livello decisionale, colleghi a cui riferisce e altri che invece riportano a lui, anche ricavare l’indirizzo email aziendale a cui poi indirizzare l’attacco. Può inoltre analizzare i contenuti multimediali presenti sui profili LinkedIn, oltre che i testi, ricavando così anche gli interessi e i temi che per il profilo sono rilevanti.

CLICCA QUI PER CONTINUARE A LEGGERE

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

-1749821006062.jpg--chieri__cantieri_e_viabilita__lavori_sul_gas_e_nuove_strisce_pedonali_in_arrivo.jpg?1749821006101#)

_(64)-1776923514265.jpg--licei__nuovi_programmi_in_arrivo_tra_intelligenza_artificiale__materie_ripensate_e_centralita_dello_studente.jpg?1776923514405#)