Perché l’AI non sostituisce i dirigenti pubblici

lentepubblica.it

L’intelligenza artificiale (AI) sta trasformando la pubblica amministrazione, ma il ruolo dei dirigenti resta cruciale. L’AI può elaborare dati e generare bozze, ma la presa di decisioni richiede giudizio umano e responsabilità. È necessario formare dirigenti capaci di integrare l’AI, riconoscendo i suoi limiti e mantenendo la fiducia tra le persone.

C’è una domanda che circola negli uffici pubblici italiani, spesso sottovoce, a volte con una punta d’ansia: se l’intelligenza artificiale può redigere atti, analizzare dati, rispondere ai cittadini e istruire procedimenti, a cosa serve il dirigente?

È una domanda legittima. E la risposta — paradossale solo in apparenza — è che il dirigente pubblico non è mai stato così necessario come adesso.

La trappola dell’automazione

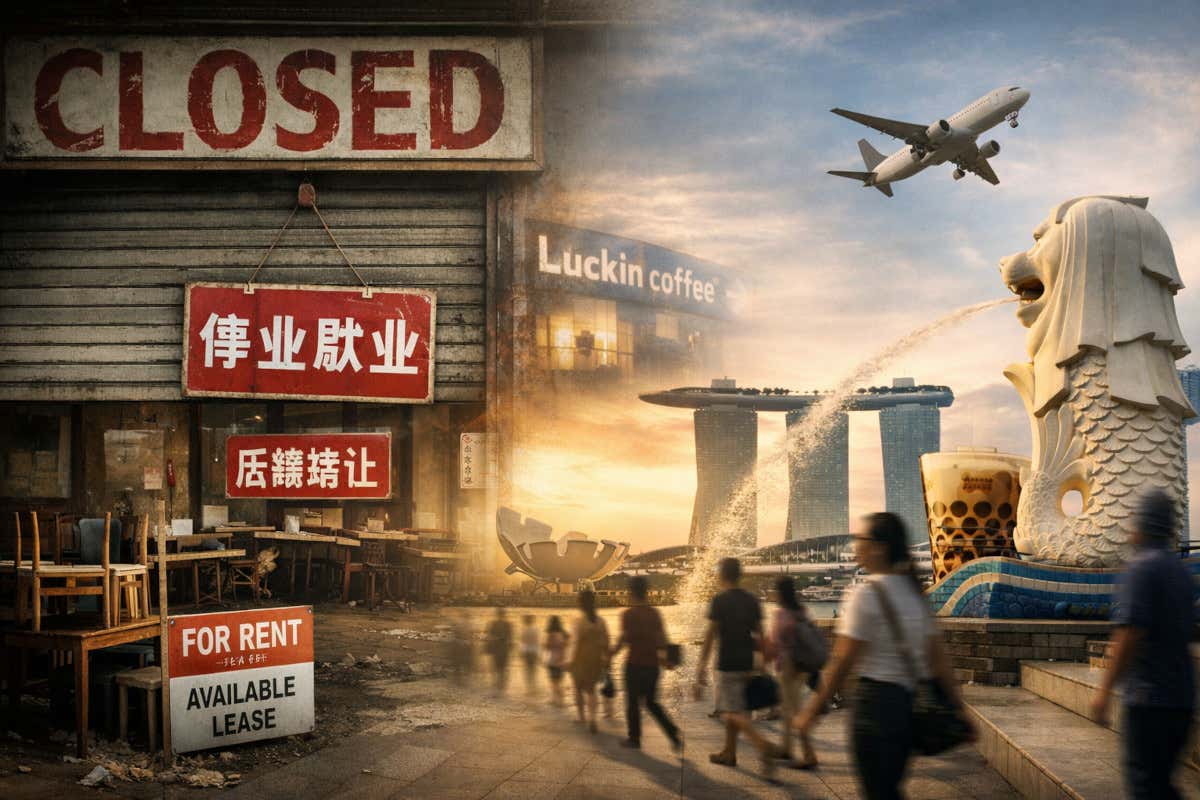

Ragionare di AI nella pubblica amministrazione richiede di smontare un equivoco di fondo: l’idea che digitalizzare significhi sostituire. Non funziona così, o almeno non per le funzioni che contano davvero.

L’intelligenza artificiale generativa sa fare cose straordinarie. Elabora in secondi ciò che richiederebbe ore di lavoro manuale. Trova pattern in banche dati che nessun occhio umano potrebbe scandagliare. Produce bozze, sintesi, risposte. Ma fa tutto questo senza capire nel senso pieno del termine: senza la consapevolezza del contesto istituzionale, senza la percezione del peso di una decisione su una vita concreta, senza la responsabilità giuridica che nell’ordinamento italiano ricade sempre e comunque su una persona fisica.

Il d.lgs 165/2001 — il testo unico del pubblico impiego — non lo dice esplicitamente perché non poteva immaginare i Large Language Models, ma lo presuppone strutturalmente: la dirigenza pubblica è titolare di poteri, non di funzioni meccaniche. Adottare un provvedimento, gestire un conflitto interno, valutare un collaboratore, rappresentare l’amministrazione in una crisi: sono atti che richiedono giudizio, e il giudizio è irriducibilmente umano.

Cosa succede quando si confonde lo strumento con il decisore

Immaginiamo un dirigente di un ente locale che decide di affidare all’AI l’istruttoria delle domande di accesso ai servizi sociali. L’algoritmo è ben costruito, i dati sono puliti, i criteri sono coerenti con il regolamento. Tutto funziona. Finché arriva una famiglia la cui situazione non rientra perfettamente in nessuna categoria prevista: un nucleo complesso, con una storia di fragilità multiple, che il sistema classifica come “non prioritario”.

Chi decide in quel momento? L’algoritmo ha già detto la sua. Ma la decisione finale — quella che può cambiare o confermare un destino — spetta ancora a qualcuno. E quel qualcuno deve avere la competenza per capire quando lo strumento ha ragione e quando ha torto.

Questo è il cuore del problema. Non si tratta di essere favorevoli o contrari all’AI. Si tratta di non dimenticare che tra il dato e il provvedimento c’è sempre un passaggio di giudizio che la macchina non può compiere in autonomia, almeno non senza un presidio umano consapevole.

Il Piano nazionale di governo degli algoritmi, elaborato nell’ambito della strategia italiana per l’intelligenza artificiale, pone esattamente questo principio al centro: la supervisione umana non è un optional, è una condizione di legittimità.

Le tre competenze che l’AI non può replicare

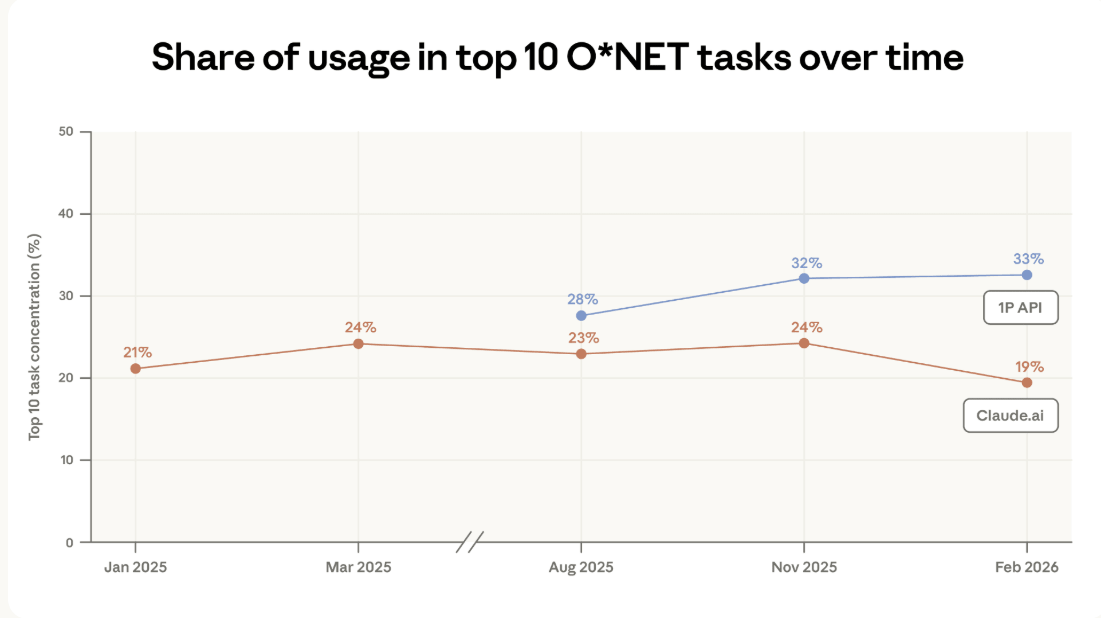

McKinsey, in una ricerca pubblicata a gennaio 2026, ha identificato tre dimensioni della leadership che restano prerogativa umana nell’era dell’AI: fissare le aspirazioni, prendere le decisioni difficili, generare idee originali. Sono categorie astratte, ma nel contesto della PA italiana acquistano una concretezza molto precisa.

Il giudizio contestuale. Un dirigente pubblico opera in un sistema di vincoli normativi, politici e istituzionali che nessun algoritmo può pienamente mappare. La discrezionalità amministrativa — quel margine di valutazione che la legge rimette all’amministrazione — non è un difetto del sistema, è la sua intelligenza adattiva. È il riconoscimento che il diritto da solo non basta, che la realtà è sempre più complessa delle categorie che proviamo ad applicarle.

L’empatia come strumento di governance. Gestire un team di dipendenti pubblici in una fase di trasformazione rapida — come quella che stiamo attraversando — richiede qualcosa che non si impara dai manuali: la capacità di sentire dove c’è resistenza, paura, disorientamento. E di rispondervi non con circolari, ma con presenza, ascolto, senso. I ricercatori di McKinsey parlano di vulnerability come risorsa di leadership: ammettere di non avere tutte le risposte genera fiducia, non debolezza. Nel settore pubblico, dove la cultura organizzativa è spesso ancora gerarchica e difensiva, questo spostamento è rivoluzionario.

La responsabilità come fondamento dell’agire pubblico. Nell’ordinamento italiano, la responsabilità dirigenziale è disciplinata con precisione: risponde dei risultati, risponde dei comportamenti del personale, risponde delle risorse gestite. Questa responsabilità non si delega a un sistema informatico. E non è solo un vincolo giuridico: è il presupposto etico dell’azione pubblica. Il cittadino che riceve un diniego, o un servizio inadeguato, ha diritto a sapere che dall’altra parte c’è una persona che ha scelto, non un algoritmo che ha calcolato.

Cosa deve cambiare, allora

Se il dirigente pubblico diventa più essenziale nell’era dell’AI, bisogna che i sistemi di formazione, selezione e valutazione lo riconoscano.

Il percorso di accesso alla dirigenza, così come riformato dal decreto attuativo della legge delega Zangrillo, introduce elementi interessanti: maggiore attenzione alle competenze manageriali, percorsi di sviluppo professionale, una concezione meno burocratica del ruolo. Ma la vera sfida è culturale prima che normativa. Formare dirigenti capaci di lavorare con l’AI — non di subirla, non di ignorarla — richiede un investimento che va molto oltre i corsi di aggiornamento obbligatori.

Occorre costruire una nuova alfabetizzazione critica: non trasformare i dirigenti pubblici in ingegneri informatici, ma renderli capaci di interrogare i sistemi automatizzati, di capirne i limiti, di riconoscere quando il risultato prodotto dall’algoritmo merita di essere messo in discussione. È la differenza tra chi usa uno strumento e chi ne è usato.

La posta in gioco è più alta di quanto sembra

C’è una ragione profonda per cui il tema della leadership umana nella PA non è solo una questione di management.

La pubblica amministrazione non produce beni o servizi nel senso stretto del termine: produce fiducia. È il luogo in cui lo Stato si fa concreto, in cui i diritti diventano prestazioni, in cui le promesse costituzionali si trasformano — o non si trasformano — in esperienza quotidiana. Questa funzione non può essere delegata a nessun sistema automatizzato, non perché l’AI sia cattiva o pericolosa, ma perché la fiducia si costruisce nella relazione tra persone.

Il dirigente pubblico che sa usare l’AI per liberare tempo e risorse da dedicare alle decisioni che contano davvero non è un sopravvissuto alla rivoluzione tecnologica. È la risposta migliore che le istituzioni possono dare a chi teme, con qualche ragione, che la digitalizzazione significhi spersonalizzazione.

L’intelligenza artificiale può rendere la PA più veloce, più accurata, più efficiente. Ma solo la leadership umana può renderla più giusta.

The post Perché l’AI non sostituisce i dirigenti pubblici appeared first on lentepubblica.it.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0