Deepfake e propaganda nel fronte invisibile della guerra in Medio Oriente

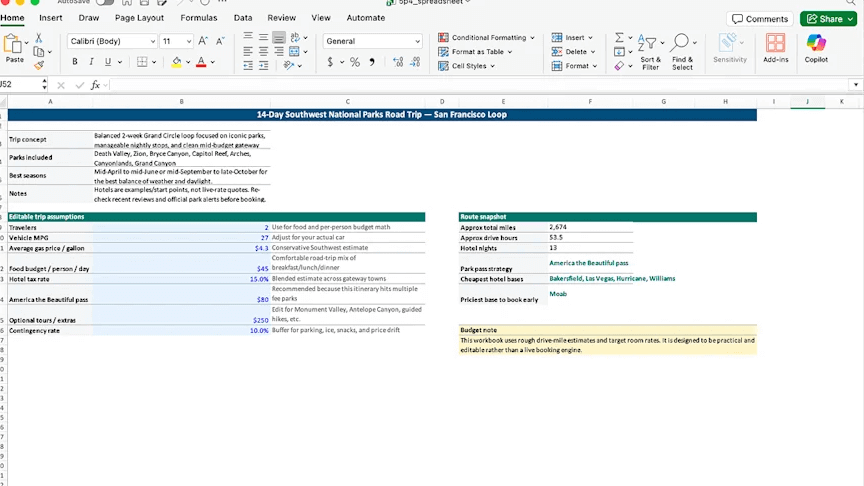

La guerra dei 12 giorni, il conflitto tra Israele e Iran del giugno 2025, era già stata definita dagli esperti dello European Digital Media Observatory come la «prima guerra dell’intelligenza artificiale» per l’uso massiccio di disinformazione e deepfake da entrambe le parti. L’operazione avviata il 28 febbraio – nome in codice Epic Fury per gli Stati Uniti, Roaring Lion per Israele – mostra come l’intelligenza artificiale nello spazio informativo sia ormai parte integrante del campo di battaglia.

Il conflitto di giugno, con attacchi missilistici mirati contro siti del nucleare iraniano, ha visto le azioni cinetiche accompagnate da una campagna parallela sul piano informativo. Media e proxy, israeliani e iraniani, hanno provato a capitalizzare, o a contenere i danni, rilanciando in quantità immagini e video fuori contesto o generati con l’intelligenza artificiale. I casi più emblematici includono media iraniani che, anche sui loro canali social, hanno diffuso video e immagini delle presunte rovine di Tel Aviv dopo un raid iraniano o dei resti di un F-35I abbattuto dalla contraerea di Teheran. Entrambi si sono rivelati deepfake generati con l’intelligenza artificiale, secondo analisi di fact-checker indipendenti. Un altro video fake, realizzato addirittura prima che il conflitto scoppiasse, mostrava un enorme cratere in una città israeliana non ben identificata. In altri casi, circolavano filmati che presentavano manifestanti iraniani come sostenitori delle azioni israeliane.

Questi episodi, pensati per manipolare l’opinione pubblica interna e internazionale, mostrano come lo spazio informativo sia sempre più parte integrante del campo di battaglia. E come la narrazione del conflitto sui social, anche grazie alle potenzialità dell’intelligenza artificiale, sia diventata parte strutturale delle strategie dei combattenti, spesso sostenuti da apparati statali, media ufficiali o influencer più o meno allineati.

Gli attacchi dell’operazione Epic Fury e le risposte iraniane cominciati lo scorso fine settimana non sono stati da meno.

A seguito del lancio dell’operazione e dell’inizio dei bombardamenti israelo-americani su Teheran, con la conseguente eliminazione dell’ayatollah Ali Khamenei, lo spazio informativo si è nuovamente riempito di contenuti falsi, spesso generati con l’intelligenza artificiale.

Secondo un articolo pubblicato da Wired, già nelle prime ore di sabato mattina X sarebbe stata invasa da centinaia di post con informazioni false sull’impatto degli attacchi. In molti casi i filmati di presunti bombardamenti sono stati rilanciati attribuendoli a luoghi sbagliati. Sulla piattaforma di Elon Musk hanno iniziato a circolare anche immagini manipolate o create con l’intelligenza artificiale, e non sono mancati i post che spacciavano scene tratte da videogiochi per video dal fronte.

Molti di questi contenuti sono stati condivisi da account “verificati” con la spunta blu, che li rende idonei a ricevere un compenso dalla piattaforma. Un dettaglio che mette in luce un volto della disinformazione spesso sottovalutato ma in forte crescita: quello di contenuti prodotti e rilanciati a puro scopo di lucro. Anche quando alcuni post vengono accompagnati da una community note di X, restano visibili e continuano a generare milioni di visualizzazioni.

Tra i video fake più visualizzati, secondo Wired, ci sarebbero una presunta pioggia di missili balistici su Dubai – in realtà un filmato girato a Tel Aviv nel 2024, e il video del presunto abbattimento di un jet israeliano da parte della contraerea iraniana. Quest’ultimo, nonostante l’assenza di qualsiasi conferma o riscontro indipendente, è ancora visibile su X e conta al momento oltre quattro milioni di visualizzazioni.

Secondo BBC Verify, l’unità di fact-checking e open-source intelligence dell’emittente britannica, nelle ultime ore si è assistito a una proliferazione di contenuti manipolati o decontestualizzati. Tra i casi analizzati, un vecchio video girato in Siria è stato rilanciato per sostenere falsamente che una base turca usata dagli Stati Uniti fosse stata attaccata. E un’immagine satellitare che pretendeva di mostrare i danni a una base navale americana in Qatar si è rivelata un falso generato con l’intelligenza artificiale – costruito a partire da immagini satellitari reali di una base Usa in Bahrein, risalenti al 2025 e disponibili su Google Earth.

La stessa redazione ha poi smontato l’immagine di una gigantesca esplosione attribuita a una base Usa in Iraq. Anche in questo caso il contenuto – ricavato da uno scatto autentico dell’aeroporto di Erbil – era stato modificato con strumenti di intelligenza artificiale. Infine, dopo la nomina del consiglio provvisorio in Iran, sono comparsi su X almeno due account a nome dell’ayatollah Alireza Arafi, creati il giorno stesso dell’annuncio e usati per rilanciare contenuti non verificati – in un caso con spunta blu, nonostante non risultasse l’esistenza di un profilo ufficiale.

Ovviamente, l’eliminazione dell’Ayatollah Khamenei non poteva sfuggire alla propaganda IA. Secondo Factanameh, organizzazione iraniana di fact-checking con sede in Canada e membra dell’International Fact-Checking Network, almeno due video deepfake che mostrerebbero il corpo del leader sotto le rovine sono stati diffusi sui social iraniani. I due filmati mostrerebbero la Guida Suprema estratta dalle macerie dopo il bombardamento, ma presentano chiari segnali di manipolazione. Nel primo, il volto appare innaturalmente levigato e privo di ferite coerenti con il contesto, mentre mani e dettagli dell’uniforme cambiano forma da un fotogramma all’altro. Nel secondo, le proporzioni del corpo e le ombre risultano incoerenti ed alcuni elementi sullo sfondo si deformano, indizi tipici di contenuti generati con l’intelligenza artificiale.

Questi video, diffusi in modo massiccio sia dagli oppositori che dai sostenitori del regime, mostrano come i deepfake IA vengano usati nei contesti di conflitto per mobilitare e polarizzare l’opinione pubblica interna, del nemico o internazionale, e ottenere un effetto moltiplicatore rispetto agli strumenti di propaganda tradizionali.

La questione non è limitata alla circolazione di deepfake. Bensì ha a che fare con l’ecosistema che li premia (in questo caso X) e li rende utili sul piano operativo e propagandistico alle parti in conflitto, trasformando l’intelligenza artificiale in un moltiplicatore della propaganda. La risposta, per ora affidata a open-source intelligence e fact-checker che ricostruiscono la catena delle immagini, è una corsa tutta in salita.

L'articolo Deepfake e propaganda nel fronte invisibile della guerra in Medio Oriente proviene da Linkiesta.it.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

-1773056355177.jpg--fuga_in_auto_nel_centro.jpg?1773056355242#)

-1773056610594.jpg--guida_con_patente_non_convertita.jpg?1773056610626#)

-1773057957911.jpg--colpito_alla_testa.jpg?1773057957951#)

-1773058157904.jpg--lite_per_gelosia.jpg?1773058157951#)