Intelligenza artificiale generativa: uno specchio, non un terapeuta

Secondo l’Ordine degli Psicologi della Toscana sta crescendo l’utilizzo dell’intelligenza artificiale come strumento di analisi psicologica, anche in chiave autoterapeutica. Ma la relazione umana resta insostituibile

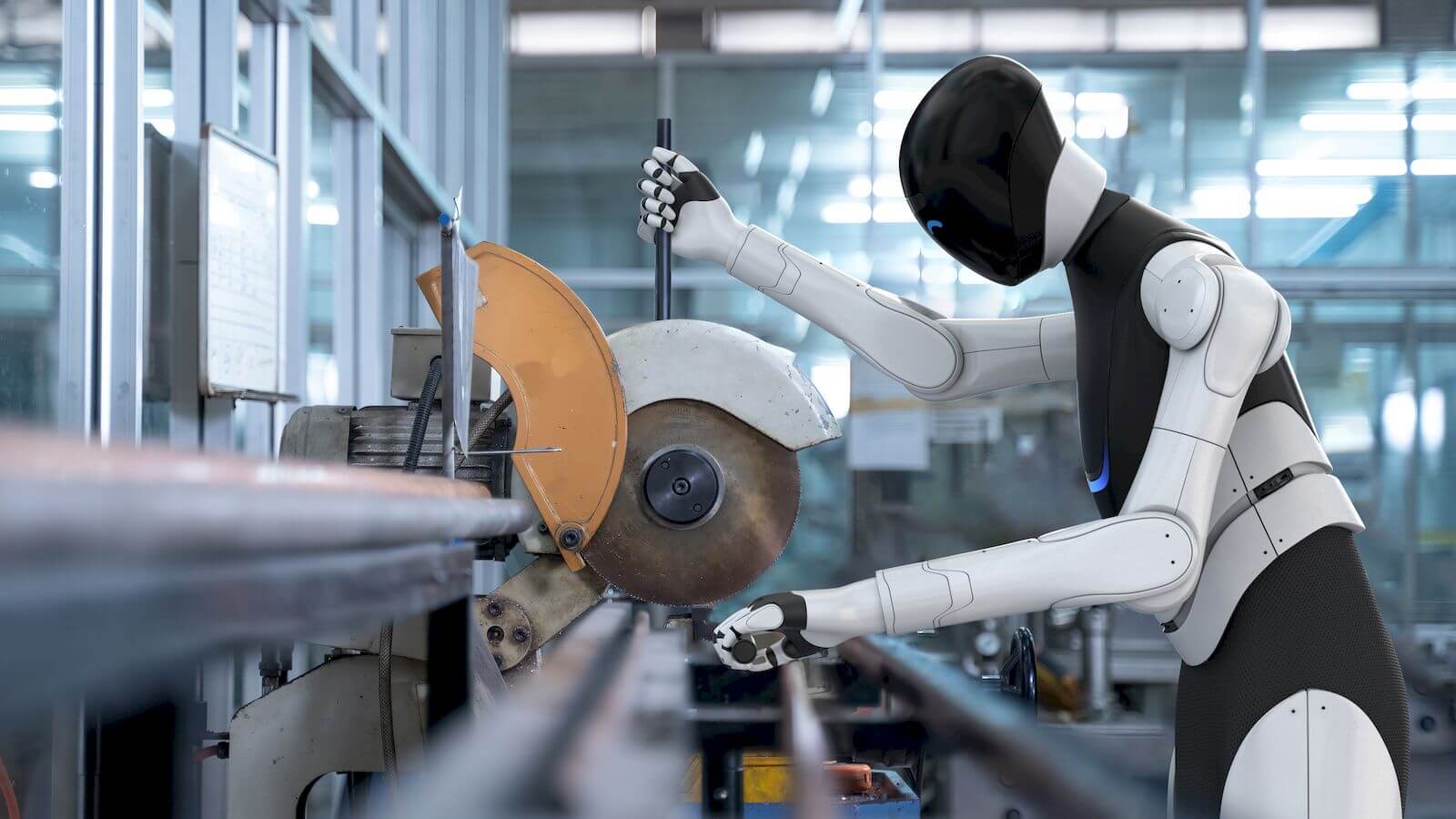

L’intelligenza artificiale generativa si sta affermando anche come interlocutore nelle fasi di disagio psicologico: lo rileva l’Ordine degli Psicologi della Toscana, segnalando un uso crescente di chatbot evoluti come strumento di autoterapia, in particolare tra i soggetti giovani-adulti e digitalmente alfabetizzati.

Un fenomeno che, pur rivelando la potenzialità di questi strumenti nell’offrire supporto temporaneo o nel favorire la verbalizzazione delle emozioni, solleva interrogativi rilevanti sul piano etico e clinico.

Secondo uno studio pubblicato su Nature Machine Intelligence (2023), il 17% degli utenti tra i 18 e i 34 anni negli Stati Uniti ha dichiarato di utilizzare regolarmente chatbot basati su Ai per “parlare dei propri problemi“.

Tuttavia, sebbene l’interazione possa generare un sollievo immediato, manca la dimensione fondamentale del transfert e dell’ascolto empatico, propri della relazione terapeutica.

Il rischio, infatti, non è l’uso dell’Ai, ma il suo fraintendimento come surrogato terapeutico. E su questo fronte, la responsabilità è culturale prima ancora che tecnologica.

Non si trasformi l’Ai in uno strumento di autoterapia

Per questo l’Ordine degli Psicologi, attraverso la sua presidente, Maria Antonietta Gulino, rivolge ai lettori di GreenPlanner, questa lettera aperta, che pubblichiamo.

“L’intelligenza artificiale generativa non può sostituire la relazione psicologica – scrive Gulino – La nostra posizione è netta: l’intelligenza artificiale può offrire strumenti utili, ma non potrà mai replicare il cuore della relazione terapeutica, che è fatta di presenza, sintonizzazione emotiva, silenzi, complessità. Pensare il contrario significa banalizzare la sofferenza e mettere a rischio la salute psicologica delle persone.

L’uso indiscriminato di chatbot e sistemi generativi, privi di supervisione professionale, rischia di alimentare forme di auto-terapia pericolose, in particolare tra i più giovani, esponendo le persone a confusione, dipendenza affettiva dagli assistenti virtuali e ritardo nell’accesso a un aiuto professionale qualificato.

L’Ia può svolgere un ruolo importante nel supportare il lavoro dello psicologo, per esempio nell’organizzazione dei dati, nell’intercettazione precoce del disagio, nella psicoeducazione. Ma deve restare uno strumento, non un sostituto. La regia deve essere sempre in mano al professionista“.

Per affrontare questa sfida, l’Ordine chiede un quadro normativo chiaro e rigoroso, in linea con il regolamento europeo sull’Ai: trasparenza degli algoritmi, appropriatezza d’uso, obbligo di dichiarazione esplicita per i sistemi che si presentano come terapeutici e il divieto di simulare ruoli umani nei contesti psicologici.

“Serve un impegno strutturato – conclude Gulino – fatto di formazione, vigilanza, alfabetizzazione digitale e collaborazione con le istituzioni. Vogliamo che le psicologhe e gli psicologi italiani siano protagonisti attivi di questa transizione, capaci di governare l’innovazione senza smarrire la propria identità e la funzione sociale della nostra professione. La tecnologia non è neutra: spetta a noi guidarne l’uso, per tutelare il benessere delle persone“.

L'articolo Intelligenza artificiale generativa: uno specchio, non un terapeuta è stato pubblicato su GreenPlanner Magazine.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

/https://www.finanza.com/app/uploads/2025/08/europa-paesi-con-salari-minimi-piu-alti-e-piu-bassi.jpg)

/https://www.finanza.com/app/uploads/2025/08/wp_drafter_179955.jpg)

/https://www.finanza.com/app/uploads/2025/08/con-trade-republic-hai-carta-debito-visa-2-percento-liquidita.jpg)

/https://www.finanza.com/app/uploads/2025/08/telemarketing-stretta-dal-19-agosto-ecco-la-novita.jpg)

-1754133631392.png--valerio_minato_svela_il_volto_in_movimento_del_monviso_sotto_le_stelle.png?1754133631616#)