OpenAI rafforza la sicurezza mentre i modelli AI crescono nel cyber

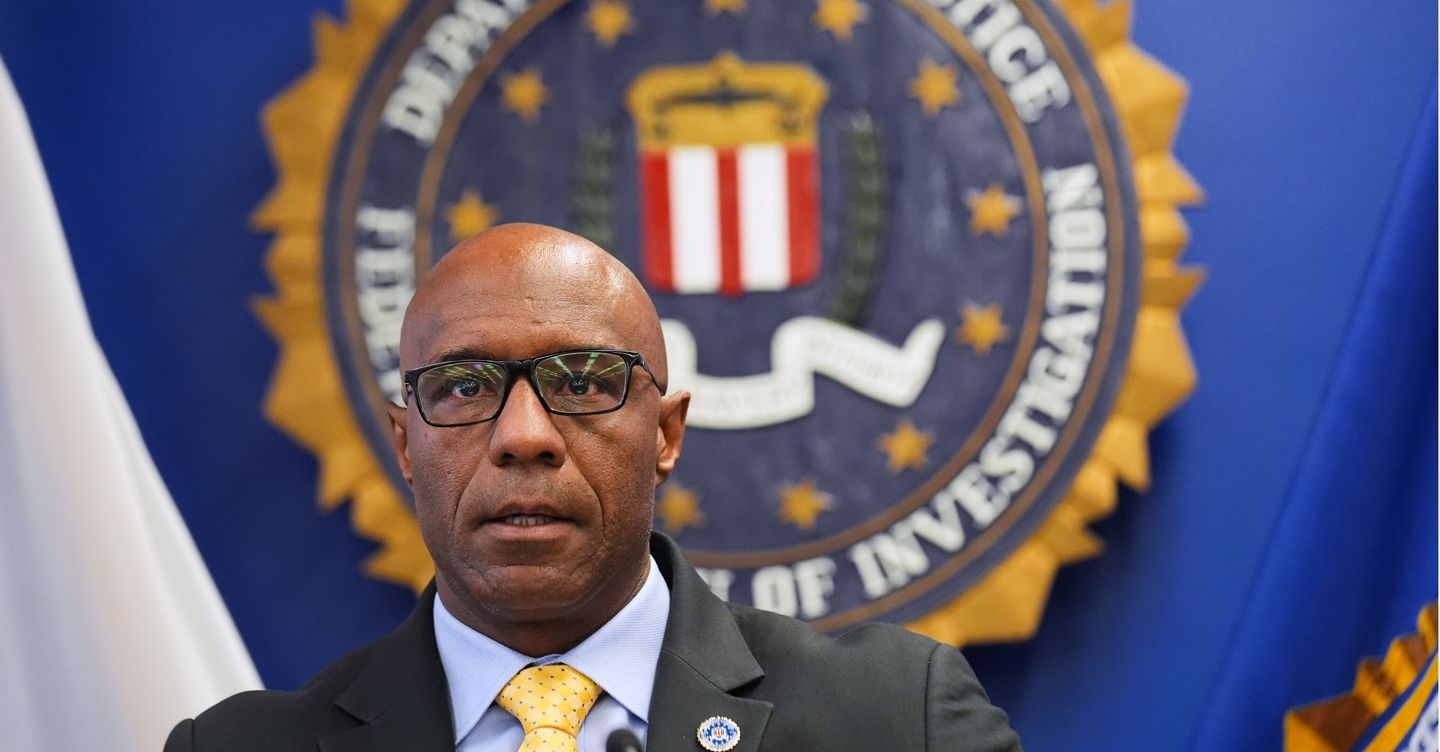

L’evoluzione dell’AI sta accelerando anche nel campo della cybersicurezza, con capacità tecniche che fino a poco tempo fa sembravano appannaggio esclusivo di esperti umani. È in questo scenario che OpenAI ha annunciato un rafforzamento significativo delle proprie misure di protezione, anticipando un futuro in cui i modelli di frontiera potrebbero raggiungere livelli di competenza tali da rappresentare un rischio se utilizzati in modo improprio.

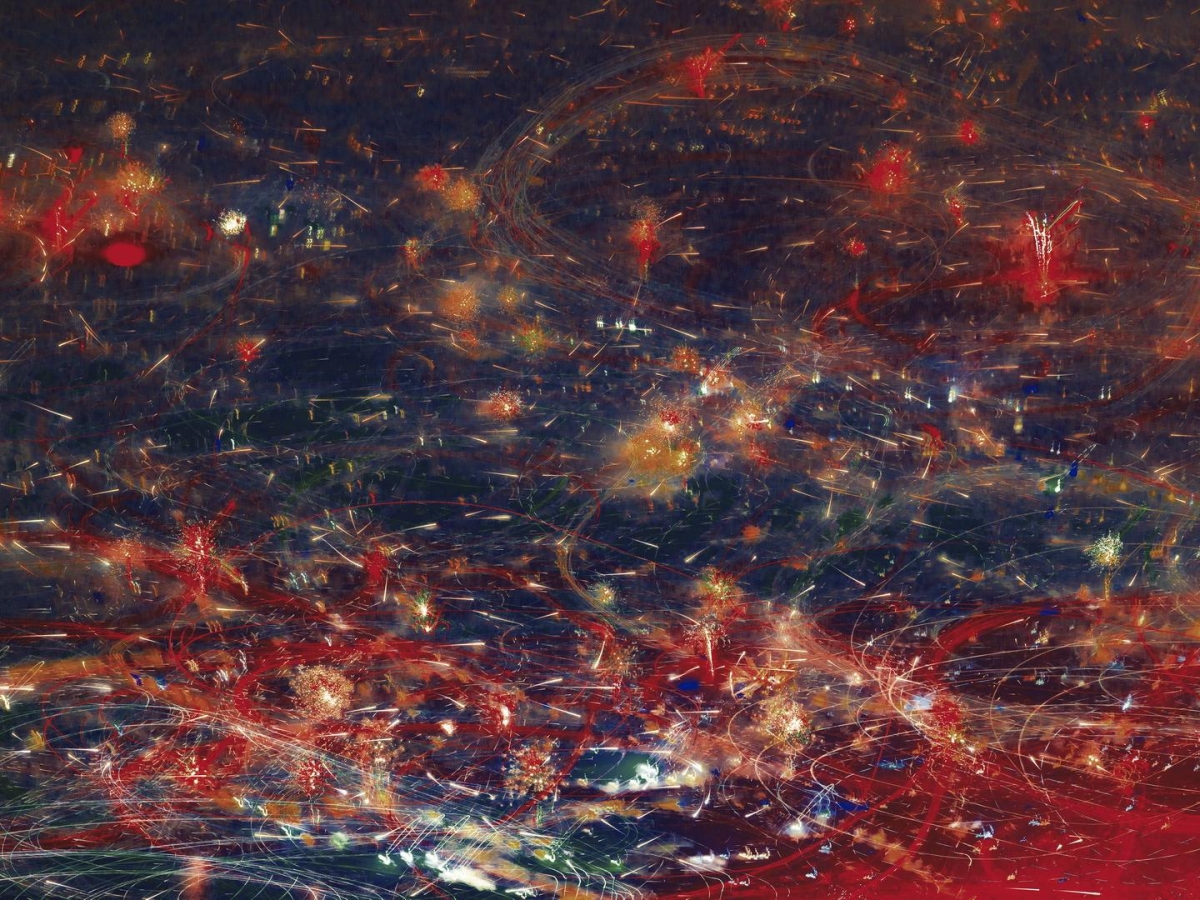

Secondo i dati diffusi dall’azienda, le prestazioni dei suoi modelli in contesti di sicurezza informatica sono cresciute in modo marcato nel giro di pochi mesi. Nei test di tipo Capture The Flag, utilizzati per valutare le abilità tecniche in ambito cyber, i risultati sono passati dal 27% ottenuto da GPT-5 nell’agosto 2025 al 76% raggiunto da GPT-5.1-Codex-Max nel novembre dello stesso anno. Un salto che, per OpenAI, dimostra quanto rapidamente questi sistemi stiano acquisendo competenze avanzate, comprese quelle necessarie per individuare vulnerabilità o analizzare infrastrutture complesse.

L’azienda riconosce che i futuri modelli potrebbero rientrare nella categoria di “alta capacità” prevista dal proprio Preparedness Framework, una soglia che include la possibilità di sviluppare exploit zero-day o di supportare intrusioni sofisticate in reti aziendali. Proprio per questo, la strategia dichiarata è quella di prepararsi come se ogni nuovo modello fosse potenzialmente in grado di raggiungere quel livello, affiancando alla crescita delle prestazioni un sistema di controlli sempre più articolato.

CLICCA QUI PER CONTINUARE A LEGGERE

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

![[SPOILER] Sandokan anticipazioni Lunedi 15 Dicembre: Una penultima puntata da non perdere!](https://images.everyeye.it/img-notizie/-spoiler-sandokan-anticipazioni-lunedi-15-dicembre-penultima-puntata-non-perdere-v3-848485-800x600.webp?#)

-1765811392801.jpg--_il_tango_delle_capinere___foto_di_scena_di_rosellina_garbo.jpg?1765811392999#)

-1754133631392.png--valerio_minato_svela_il_volto_in_movimento_del_monviso_sotto_le_stelle.png?1754133631616#)