La “riserva di umanità” nei concorsi pubblici automatizzati

lentepubblica.it

Il TAR Lazio anticipa l’AI Act: il controllo umano è il limite invalicabile per la legittimità delle procedure digitali.

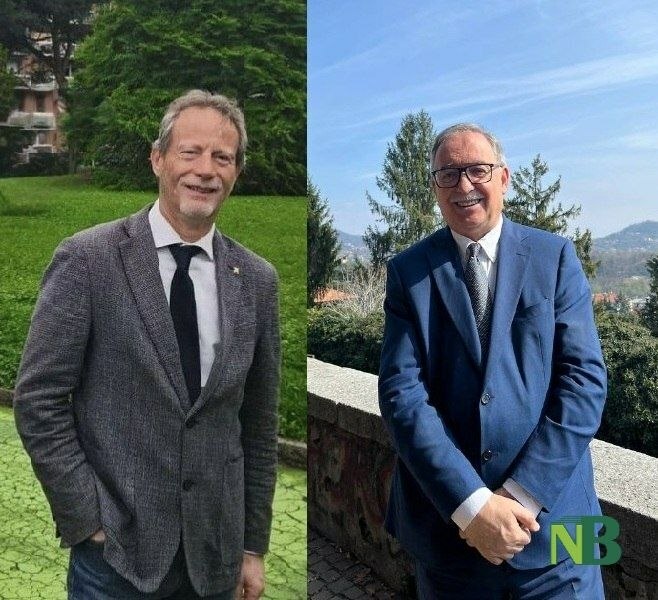

di Maurizio Campagna e Claudio Cicu

Il TAR Lazio (sez. III-bis), con la sentenza n. 1895 del 2 febbraio 2026, affronta il tema dell’impiego di sistemi automatizzati nei concorsi pubblici, delineando il perimetro delle garanzie procedimentali a tutela dei candidati. La pronuncia chiarisce un punto fondamentale: la digitalizzazione dell’azione amministrativa non può tradursi in un affievolimento dei principi di imparzialità e buon andamento. Non deve, inoltre, sfociare in automatismi rigidi che sacrifichino la sostanza dei requisiti posseduti in favore di meri oneri formali di compilazione.

Il fatto

La sentenza trae origine dal ricorso di un candidato al concorso per la scuola secondaria (classe A001 – Arte e Immagine) nella Regione Lazio. L’interessato si era visto negare sia l’applicazione della riserva del 30% dei posti – prevista dal bando per i candidati con almeno tre anni di servizio, nonostante avesse effettivamente maturato tale anzianità – sia la valutazione di un ulteriore titolo accademico, finendo così escluso dal novero dei vincitori.

Il candidato, pur avendo indicato le annualità di servizio – valutate correttamente ai fini dell’attribuzione del punteggio finale – aveva, infatti, omesso di contrassegnare nella domanda di partecipazione l’opzione per indicare la volontà di avvalersi della riserva del 30%.

L’Amministrazione si è difesa sostenendo che la graduatoria era stata formata nel pieno rispetto delle disposizioni del bando: la domanda assume, infatti, valore di autocertificazione e ricade sul candidato l’onere esclusivo di verificare la correttezza e la completezza dei dati prima dell’invio definitivo. Il “sistema automatizzato”, quindi, si sarebbe limitato a processare le informazioni fornite dal candidato.

Il primato della sostanza sulla forma

Ad avviso del giudice amministrativo, la tesi dell’Amministrazione non è risultata convincente. Sebbene il candidato avesse omesso di contrassegnare la casella dedicata, la volontà di usufruire del beneficio della riserva era chiaramente desumibile dal contesto complessivo della domanda, all’interno della quale i requisiti necessari erano stati comunque dichiarati. Gli stessi, infatti, erano stati valutati ai fini dell’attribuzione del punteggio finale.

Il TAR ha ricordato il principio generale per cui, nelle procedure non automatizzate, l’indicazione di un requisito in una sezione errata del modulo non ne preclude la valutazione ai fini della composizione della graduatoria. Secondo un orientamento giurisprudenziale consolidato, infatti, l’Amministrazione è tenuta a considerare ogni dichiarazione resa – al di là della forma o del nomen iuris utilizzato – purché essa risulti completa dei requisiti di validità ed efficacia richiesti (Consiglio di Stato, sez. V, 25 marzo 2020, n. 2091).

In questa prospettiva, il TAR Lazio ha richiamato anche un proprio precedente nel quale è stata confermata la validità di requisiti dichiarati esclusivamente nel curriculum vitae. Laddove, infatti, il bando indichi il curriculum tra i documenti da allegare obbligatoriamente ai fini della valutazione, quest’ultimo diventa parte integrante della domanda. Di conseguenza, l’Amministrazione non può ignorare le informazioni in esso contenute, poiché la stessa lex specialisqualifica il documento quale “fonte” per la conoscenza dei titoli posseduti (TAR Lazio, sez. II, 19 gennaio 2022, n. 636).

La “riserva di umanità” come principio emergente

Il principio della prevalenza della sostanza deve valere, a maggior ragione secondo il TAR, nelle procedure che prevedono l’impiego di sistemi di intelligenza artificiale, contesti in cui «non può essere pretermessa la riserva di umanità».

L’utilizzo di strumenti automatizzati non avviene in un vuoto giuridico, ma deve essere rigorosamente vagliato alla luce del nuovo quadro normativo europeo e nazionale. Il riferimento è al Regolamento (UE) 2024/1689 (il cosiddetto “AI Act”) e alla Legge 23 settembre 2025, n. 132, che costituisce il primo quadro normativo nazionale per la ricerca, la sperimentazione, lo sviluppo, l’adozione e l’applicazione di sistemi e di modelli di intelligenza artificiale (IA).

Tali fonti non sono tuttavia direttamente applicabili ratione temporis al caso in esame. Pur rientrando i sistemi di reclutamento del personale nel perimetro dei sistemi «ad alto rischio» (ai sensi del combinato disposto dell’art. 6 e dell’All. III), le relative prescrizioni europee non potrebbero essere richiamate direttamente come parametro di legittimità per la procedura in contestazione. Il bando di concorso del 2023 e il provvedimento impugnato del 2024 sono, infatti, antecedenti alla piena applicabilità dei nuovi obblighi europei e nazionali. L’AI Act, in particolare, entrato in vigore il 1° agosto 2024, prevede un regime di applicazione differita per gli obblighi concernenti i sistemi ad alto rischio. Tra questi rientra la supervisione umana, di cui all’art. 14 del Regolamento, astrattamente applicabile al caso di specie, ma destinata a divenire pienamente vincolante solo a decorrere dal 2 agosto 2026.

Sul punto, il TAR Lazio delinea un discrimine di fondamentale importanza, tracciando un confine netto tra la vigenza formale delle norme e la loro piena applicabilità da un lato, e la loro rilevanza quale parametro interpretativo e conformativo dall’altro.

Facendo leva sulla consolidata giurisprudenza della Corte di Giustizia UE, il TAR Lazio ha affermato che dall’AI Act possono trarsi principi interpretativi in grado di conformare l’azione della Pubblica Amministrazione già nella fase attuale. Secondo il Collegio, l’obbligo di interpretazione conforme non scatta solo al momento della piena efficacia della norma, ma opera come un criterio di orientamento costante per il giudice e per la PA.

I principi dell’AI Act, per quanto non ancora immediatamente applicabili, risultano infatti “emergenti” e pertanto in grado di vincolare gli Stati membri a non intraprendere azioni, nel periodo intercorrente tra l’entrata in vigore del Regolamento e la sua piena efficacia, che possano compromettere il risultato che l’UE intende raggiungere. Tale dovere di stand-stillimpone alle autorità di astenersi da prassi manifestamente incompatibili con gli obiettivi europei.

I giudici nazionali d’altro canto devono privilegiare un’interpretazione conforme a tali principi, garantendo la “riserva di umanità” nei procedimenti automatizzati.

Anche se gli obblighi dell’art. 14 scatteranno dal 2 agosto 2026, l’automazione non può oggi tradursi in una delega cieca al sistema, dovendo l’Amministrazione conservare un effettivo potere di controllo e correzione.

I sistemi di IA ad alto rischio nell’ambito dell’AI Act

La pronuncia del TAR assume particolare rilievo sotto il profilo sistematico nella misura in cui richiama l’AI Act quale fonte di indirizzo interpretativo e riconduce i sistemi di IA utilizzati nei procedimenti di selezione, valutazione e accesso a impieghi pubblici alla categoria dei sistemi ad alto rischio di cui all’art. 6 e all’All. III, valorizzando al contempo il correlato requisito della supervisione umana effettiva, pur in assenza di applicabilità ratione temporis dei relativi obblighi.

Per cogliere la portata di tale richiamo, occorre muovere da uno dei tratti strutturali dell’AI Act, ossia il c.d. risk based approach. L’impianto del Regolamento si fonda infatti sulla previsione di una disciplina differenziata dei sistemi di IA in funzione del rischio che essi presentano per la salute, la sicurezza e i diritti fondamentali delle persone.

In tale architettura, i sistemi di IA ad alto rischio assumono centrale rilievo, in quanto individuati in ragione della loro idoneità a produrre un impatto negativo significativo sulla salute, sulla sicurezza e sui diritti fondamentali delle persone, assumendo, in particolare, la portata del potenziale impatto sui diritti tutelati dalla Carta dei diritti fondamentali dell’Unione europea, un ruolo di particolare rilevanza ai fini della classificazione.

Categoria dei sistemi di IA ad alto rischio

La categoria dei sistemi di IA ad alto rischio si articola lungo due direttrici.

- La prima, prevista dall’art. 6, par. 1, AI Act, riguarda i sistemi di IA che costituiscono componenti di sicurezza di prodotti, o che sono essi stessi prodotti, rientranti nella normativa di armonizzazione dell’UE indicata nell’All. I, purché il prodotto sia soggetto a una procedura di valutazione della conformità da parte di un organismo terzo.

- La seconda, prevista dall’art. 6, par. 2, riguarda invece i sistemi di IA c.d. “indipendenti”, ossia non incorporati in prodotti disciplinati dalla normativa settoriale, ma destinati a essere utilizzati in specifici settori individuati dall’All. III, ritenuti ad alto rischio alla luce della loro finalità prevista e del rischio che possono comportare per i diritti fondamentali.

Tali ambiti comprendono, tra gli altri, settori quali l’istruzione, l’accesso a prestazioni essenziali e l’amministrazione della giustizia, nonché il settore che viene in rilievo nel caso di specie, relativo all’occupazione, alla gestione dei lavoratori e all’accesso al lavoro autonomo, con particolare riferimento ai sistemi di IA destinati all’assunzione o alla selezione di persone fisiche, quali quelli utilizzati per la pubblicazione di annunci mirati, l’analisi o il filtraggio delle candidature e la valutazione dei candidati.

Essi sono qualificati come sistemi ad alto rischio in ragione del loro impatto sulle prospettive di carriera, sul sostentamento e sui diritti dei lavoratori, nonché del rischio di perpetuare modelli discriminatori nel rapporto di lavoro.

Riserva di umanità e sorveglianza umana

Per l’immissione sul mercato, la messa in servizio e l’utilizzo dei sistemi di IA ad alto rischio, l’AI Act impone una serie di requisiti, differenziati in base al concreto ruolo assunto lungo la catena del valore del sistema (es. fornitore, deployer, importatore, distributore, etc.), da rispettare tenendo conto delle finalità previste, nonché dello stato dell’arte generalmente riconosciuto in materia di IA.

Tra i requisiti in questione – quali quelli attinenti alla gestione del rischio, alla governance dei dati, alla trasparenza e alla cibersicurezza – il TAR si sofferma su quello della sorveglianza umana disciplinato dall’art. 14, AI Act.

Tale requisito si inserisce, peraltro, nel più ampio approccio europeo alla regolazione dell’IA, nell’ambito del quale l’esigenza di garantire il controllo umano sui sistemi automatizzati era già stata affermata nelle Ethics Guidelines for Trustworthy AI del 2019, che individuano nella human agency and oversight uno dei requisiti fondamentali per assicurare che i sistemi di IA restino al servizio dell’essere umano e non ne compromettano i diritti fondamentali. In tale sede, la sorveglianza umana viene declinata secondo diverse modalità operative – human-in-the-loop, human-on-the-loop e human-in-command – corrispondenti, rispettivamente, a forme di intervento diretto nel processo decisionale, di supervisione del funzionamento del sistema e di controllo complessivo sul suo impiego.

Tali modalità hanno trovato una successiva traduzione normativa nell’AI Act, il quale richiede anzitutto che i sistemi di IA ad alto rischio siano progettati e sviluppati in modo da consentire una supervisione umana efficace durante il loro utilizzo, anche mediante adeguate interfacce uomo-macchina. Le misure di sorveglianza, commisurate ai rischi, al livello di autonomia del sistema e al contesto d’impiego, possono essere integrate nel sistema dal fornitore o predisposte per essere attuate direttamente dal deployer.

In ogni caso, deve essere garantito che l’operatore umano sia posto nelle condizioni di comprendere capacità e limiti del sistema, restare consapevole del rischio di un affidamento automatico o eccessivo sugli output, interpretarli correttamente, monitorarne il funzionamento ed esercitare un controllo effettivo, anche mediante la possibilità di intervenire, disattivare il sistema o discostarsi dalle sue risultanze.

La sorveglianza umana “strumento del buon andamento”

Il principio della sorveglianza umana trova solide radici nell’ordinamento. Innanzitutto, nella Costituzione e, in particolare, negli articoli 3, 24 e 97 che impongono il rispetto dei principi di uguaglianza, diritto di difesa e ragionevolezza e buon andamento dell’azione amministrativa. In quest’ottica, il TAR conferma una stretta relazione di strumentalità dell’automazione rispetto a tali principi. L’impiego della tecnologia è legittimo solo se finalizzato a migliorare il servizio reso alla collettività, e non se ridotto a un mero espediente per alleggerire il carico burocratico degli uffici.

La digitalizzazione, infatti, non può tradursi in una scorciatoia procedurale: l’efficienza algoritmica è un valore solo se garantisce una decisione più rapida ma altrettanto imparziale e conforme al principio del buon andamento. Il TAR richiama, inoltre, la legge 9 agosto 1990 n. 241 sul procedimento amministrativo. Gli articoli 1 e 3, in particolare, impongono che l’azione pubblica sia sorretta da una motivazione intelligibile e verificabile: un principio che, nel contesto degli algoritmi, si evolve necessariamente nel concetto di spiegabilità (explainability) e informazione trasparente.

In questa prospettiva, la supervisione umana prevista dall’art. 14, AI Act, pur configurandosi come requisito specificamente riferito ai sistemi ad alto rischio, si pone in linea di continuità con tale impostazione, traducendo in termini tecnico-organizzativi un’esigenza già affermata sul piano normativo e giurisprudenziale, ossia quella di preservare un controllo umano effettivo sull’esercizio della funzione amministrativa anche quando mediata da sistemi automatizzati.

Suggerimenti pratici per le Pubbliche Amministrazioni

Alla luce di quanto precede, l’impiego dell’IA nelle Pubbliche Amministrazioni richiede l’adozione di accorgimenti operativi idonei a garantire un utilizzo coerente con i principi esaminati. In particolare, appare opportuno assicurare che i sistemi automatizzati, compresi i sistemi algoritmici, operino in funzione di supporto all’attività provvedimentale, preservando un controllo umano effettivo, in linea con il principio della riserva di umanità.

Al contempo, le Amministrazioni dovrebbero modulare le misure tecniche e organizzative in funzione del livello di rischio del sistema, secondo un approccio proporzionato coerente con l’AI Act. Assume, inoltre, rilievo centrale quanto previsto dall’art. 14 della legge n. 132/2025, che qualifica – tra l’altro – l’IA come strumento di supporto all’attività decisionale e ribadisce la permanenza in capo al soggetto umano dell’autonomia e della responsabilità per i provvedimenti adottati.

The post La “riserva di umanità” nei concorsi pubblici automatizzati appeared first on lentepubblica.it.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

.JPG/_jcr_content/renditions/cq5dam.thumbnail.cropped.750.422.jpeg?#)

_(4)-1774626883559.jpg--allerta_alimentare__tonno__formaggio_e_fieno_greco_richiamati_per_rischi_di_salute.jpg?1774626883704#)

-1737228505608.png--caselle__incidente_vicino_all_aeroporto__6_feriti_non_gravi_dopo_lo_schianto.png?1737228507963#)