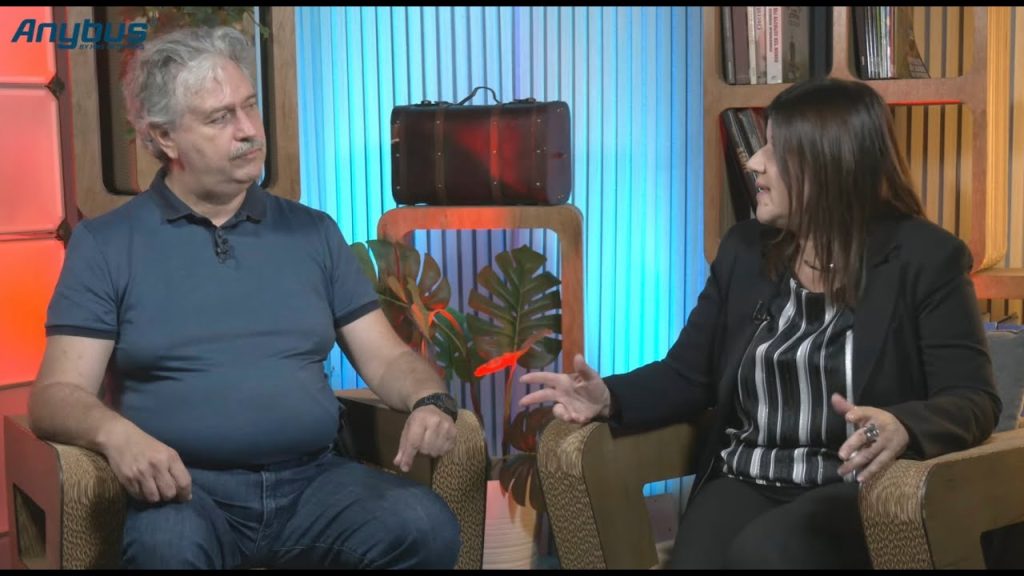

OpenAI non vuole dare le chat al New York Times

Continua lo scontro legale tra il New York Times e OpenAI. L’azienda californiana non vuole fornire agli avvocati dell’editore le 20 milioni di conversazioni degli utenti con ChatGPT, in quanto si tratta di una grave violazione della privacy. Il Times ha dichiarato che le affermazioni di OpenAI sono ingannevoli.

OpenAI vuole proteggere la privacy degli utenti

Quasi due anni fa, il New York Times ha denunciato OpenAI (e Microsoft) perché avrebbe utilizzato gli articoli (inclusi quelli protetti dal paywall) per l’addestramento dei modelli di ChatGPT. L’editore aveva inizialmente chiesto di conservare i dati di output del chatbot, ma OpenAI permette ancora di cancellare la cronologia delle chat.

Il Times ha successivamente chiesto l’accesso ad oltre 1,4 miliardi di conversazioni. L’obiettivo è trovare il testo degli articoli nelle risposte di ChatGPT per dimostrare la violazione del copyright. La giudice Ona Wang ha ordinato (PDF) a OpenAI di fornire 20 milioni di conversazioni entro il 14 novembre, dopo aver eliminato ogni dato che potrebbe consentire l’identificazione degli utenti.

L’azienda californiana non ha fornito nulla, in quanto il 99,99% delle conversazioni non riguardano la causa in corso. L’azienda ha pertanto chiesto (PDF) alla giudice di riconsiderare l’ordine. Se venisse soddisfatta la richiesta del Times, i dati di milioni di utenti finirebbero nelle mani di terze parti (avvocati e consulenti). OpenAI vuole fornire solo le conversazioni rilevanti che potrebbero includere il testo degli articoli.

Il Times ha smentito le affermazioni dell’azienda californiana:

La causa intentata dal New York Times contro OpenAI e Microsoft mira a ritenere queste aziende responsabili del furto di milioni di opere protette dal copyright per creare prodotti in diretta concorrenza con il Times. In un altro tentativo di nascondere la sua condotta illegale, il post sul blog di OpenAI inganna intenzionalmente i suoi utenti e omette i fatti. La privacy di nessun utente di ChatGPT è a rischio. Il tribunale ha ordinato a OpenAI di fornire un campione di chat, reso anonimo da OpenAI stessa, in base a un ordine di protezione legale. Questo allarmismo è ancora più disonesto se si considera che i termini di servizio di OpenAI consentono all’azienda di addestrare i propri modelli sulle chat degli utenti e di consegnare le chat in caso di contenziosi.

In diverse occasioni, OpenAI ha dimostrato che la privacy degli utenti non è una priorità. Le conversazioni sono finite nei risultati di Google Search e nella Google Search Console. L’azienda promette l’introduzione di nuove funzionalità per mantenere le chat private, tra cui la crittografia client-side.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

![Mondiale Rally. LIVE! Ecco la Ypsilon Rally2 HF Integrale [VIDEO]](https://img.stcrm.it/images/47903459/1200x/lancia-ypsilon-hf-integrale-2.jpg)

.JPG)

/https://www.finanza.com/app/uploads/2025/11/trade-republic-conto-canone-zero-offre-2-percento-liquidita.jpg)

-1754133631392.png--valerio_minato_svela_il_volto_in_movimento_del_monviso_sotto_le_stelle.png?1754133631616#)