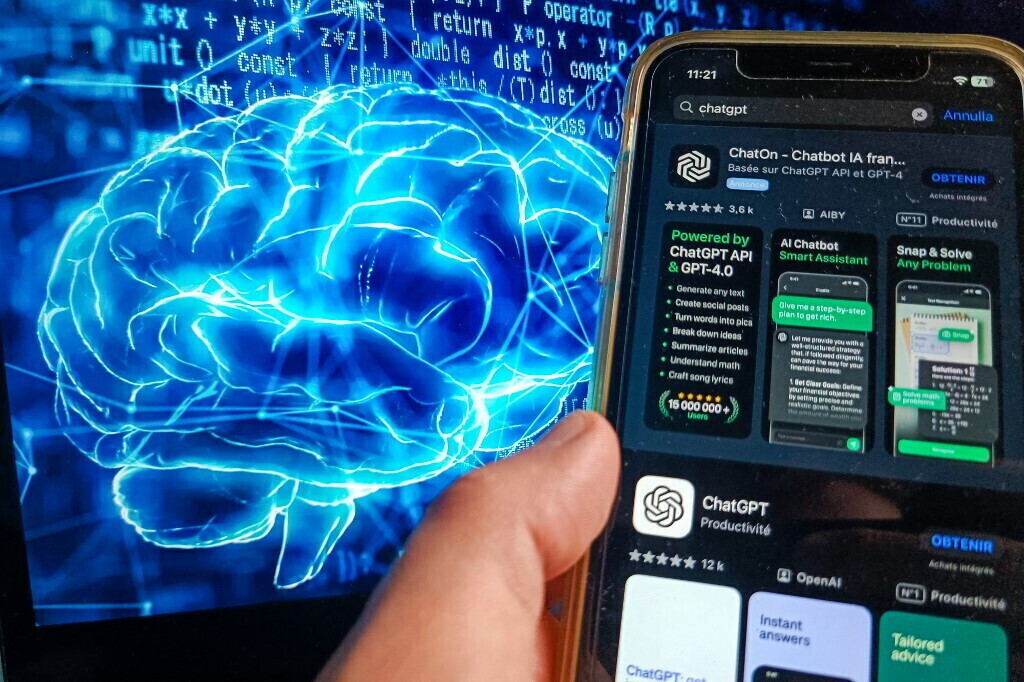

Cinque approcci per rendere l'intelligenza artificiale più affidabile

AGI - Identificate cinque pratiche per aumentare affidabilità, eticità e trasparenza dei sistemi di intelligenza artificiale, IA. A farlo un gruppo di ricerca guidato da Amir, Behzadan, delll’Institute of Behavioral Science, IBS, della CU Boulder. Tra i temi centrali dello studio, riportato su AI and Ethics, emergono l’uso di dati di alta qualità, governance rigorosa, contestualizzazione dell’IA e un’esperienza utente accurata. L’obiettivo è fornire principi pratici per aumentare affidabilità e fiducia nell’IA, considerando sia aspetti tecnici che etici, sociali e di usabilità.

I ricercatori hanno esplorato scenari che vanno dall’uso quotidiano di assistenti vocali a sistemi complessi di diagnostica o sicurezza. Le proposte si basano su una combinazione di analisi teoriche, esempi di casi reali, come esempi di chatbot, sistemi di raccomandazione, diagnostica assistita, e sintesi di buone pratiche di sviluppo, test e governance.

I cinque principi chiave sono: conoscere gli utenti, ovvero progettare l’IA tenendo conto di bisogni, competenze tecniche e norme sociali dei diversi gruppi di utenti; affidabilità, etica e trasparenza, che prevede garantire prestazioni consistenti, protezione dei dati, privacy e spiegabilità del ragionamento utilizzato per le decisioni; contesto, che richiede di integrare informazioni contestuali sufficienti per adattare i modelli alle specifiche circostanze d’uso; usabilità e feedback, ossia offrire un’ottima esperienza utente, facilitare l’interazione e raccogliere feedback per migliorare continuamente e, infine, adattabilità della fiducia; ovvero riconoscere che la fiducia può variare nel tempo e che una ripresa della fiducia può avvenire attraverso miglioramenti tangibili e trasparenza continua.

Secondo gli esperti, la fiducia nell’IA deriva dall’equilibrio tra prestazioni affidabili e trasparenza operativa, non solo dalla precisione tecnica. Lo studio ha implicazioni di carattere politico, in quanto sottolinea la necessità di standard etici e regole di accountability nelle fasi di progettazione, implementazione e monitoraggio.

Le prospettive future prevedono lo sviluppo di strumenti di valutazione della fiducia, definizione di metriche chiare per la affidabilità e “monitoring” continuo post-implementazione. Secondo i risultati, l’adozione di pratiche orientate all’affidabilità dell’IA richiede un approccio olistico che integri dati di qualità, governance, contestualizzazione e una forte attenzione all’esperienza utente. Per i ricercatori, investire in questi elementi può aumentare la fiducia pubblica e facilitare l’uso responsabile delle tecnologie intelligenti.

Qual è la tua reazione?

Mi piace

0

Mi piace

0

Antipatico

0

Antipatico

0

Lo amo

0

Lo amo

0

Comico

0

Comico

0

Furioso

0

Furioso

0

Triste

0

Triste

0

Wow

0

Wow

0

-1761333925581.jpg--moncalieri__a_100_anni_torna_a_camminare_dopo_la_frattura_del_femore___ringrazio_di_cuore_i_medici_che_mi_hanno_aiutata_.jpg?1761333926178#)

-1754133631392.png--valerio_minato_svela_il_volto_in_movimento_del_monviso_sotto_le_stelle.png?1754133631616#)